საინტერესო

ყველას ნახვახელოვნური ინტელექტი

ყველას ნახვა

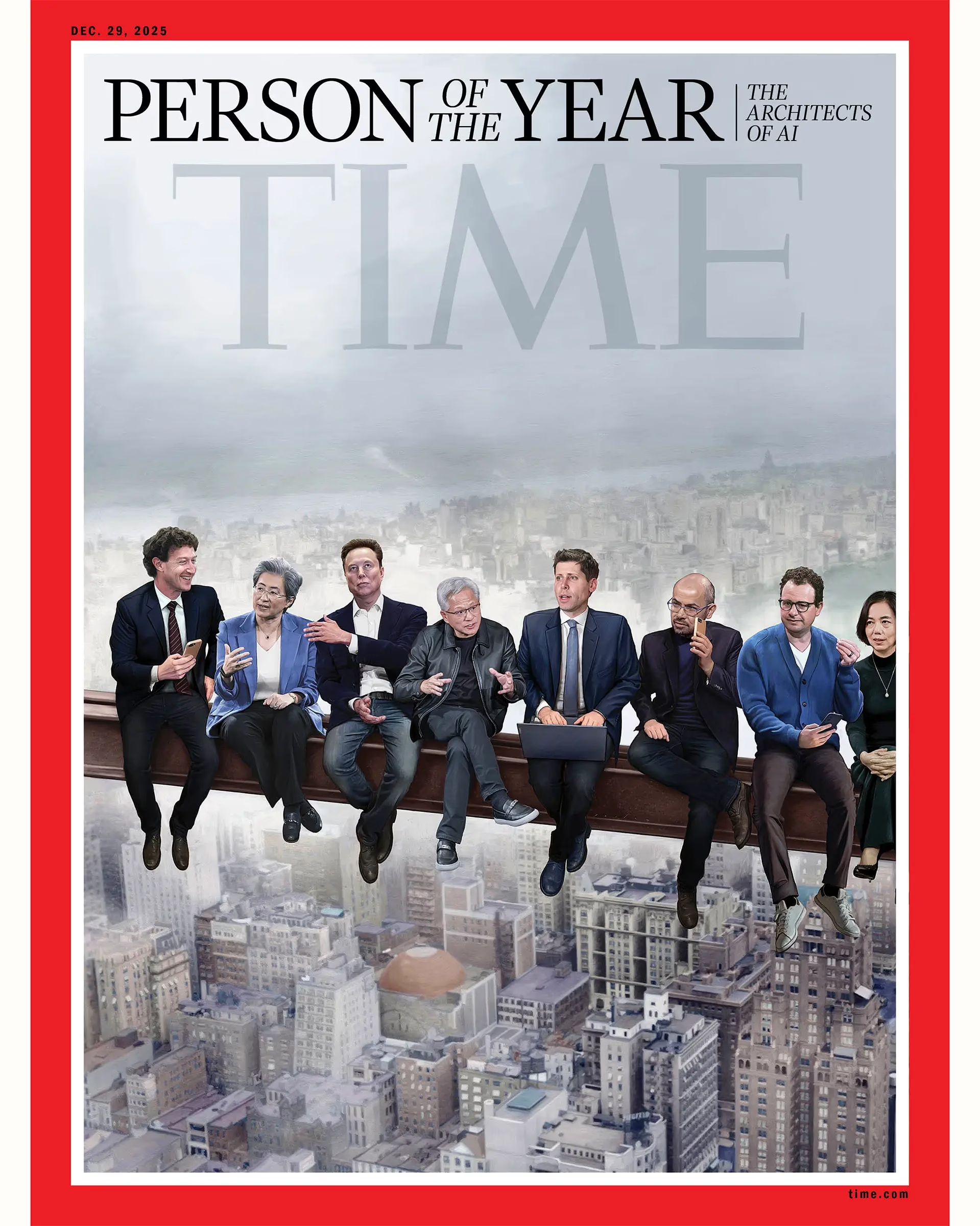

DeepSeek V4 შესაძლოა უკვე იტესტება OpenRouter-ზე — “სტელს-მოდელს” 1 ტრილიონი პარამეტრი და 1M კონტექსტური ფანჯარა აქვს

11 მარტს OpenRouter-ის პლატფორმაზე ყოველგვარი ანონსის გარეშე გამოჩნდა ორი უფასო AI-მოდელი — Hunter Alpha და Healer Alpha. არც პრესრელიზი, არც პოსტი ბლოგში, არც დეველოპერის მითითება — მხოლოდ აღნიშვნა „სტელს-მოდელი“. ერთ კვირაში Hunter Alpha-მ 160 მილიარდზე მეტი ტოკენი დაამუშავა, დეველოპერების საზოგადოებაში კი დისკუსია გაჩაღდა: ხომ არ ტესტავს DeepSeek თავის მომავალი თაობის მოდელს პირდაპირ ყველას თვალწინ? Hunter […]

Anthropic: DeepSeek-ი, Moonshot-ი და MiniMax-ი ფარულად წვრთნიდნენ თავიანთ მოდელებს Claude-ის პასუხებზე

Anthropic-მა Cloudflare-ისა და CrowdStrike-ის აქციები დააგდო Claude Code Security-ის წარდგენით

OpenAI თანამშრომლების სათვალთვალოდ ChatGPT-ს იყენებს — ხელოვნური ინტელექტი მათ Slack-სა და ელფოსტას კითხულობს

Google თავის საუკეთესო პროდუქტიულობის ინსტრუმენტებს ფასიანს ხდის

ჰარდი

ყველას ნახვა

7 საუკეთესო მინი-პერსონალური კომპიუტერი სახლისა და სამუშაოსთვის

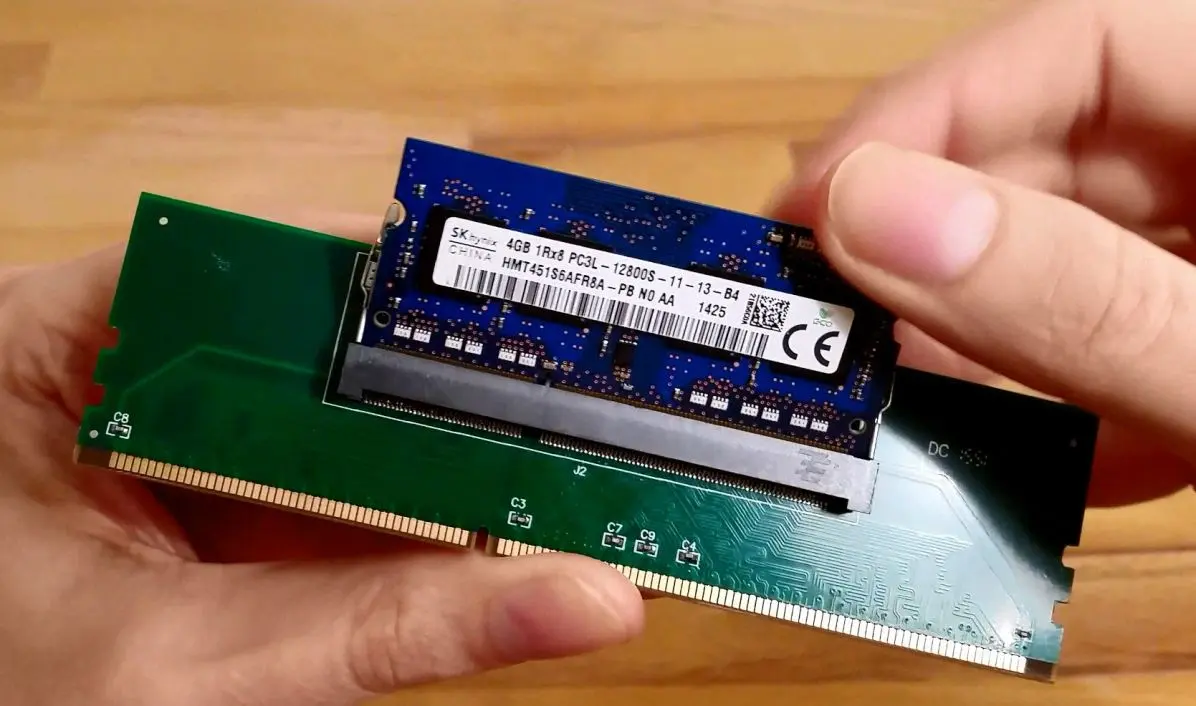

წიგნის ზომის კომპაქტურ კომპიუტერს შეუძლია შეცვალოს მასიური სისტემური ბლოკი — და ამავდროულად გაუმკლავდეს საოფისე სამუშაოს, 4K სტრიმინგს, ვიდეომონტაჟს ან ნეიროქსელებსაც კი. განვიხილოთ ბაზარზე არსებული შვიდი აქტუალური მინი-კომპიუტერი: ხელმისაწვდომი ნეტტოპებიდან საბაზისო მინიმუმით, პრემიუმ სადგურებამდე დისკრეტული ვიდეობარათის მხარდაჭერით. შედარებითი ცხრილი მოდელი პროცესორი მეხსიერება გრაფიკა Firebat AM02 Intel N100 (4 ბირთვი) 16 გბ / 512 გბ Intel UHD […]

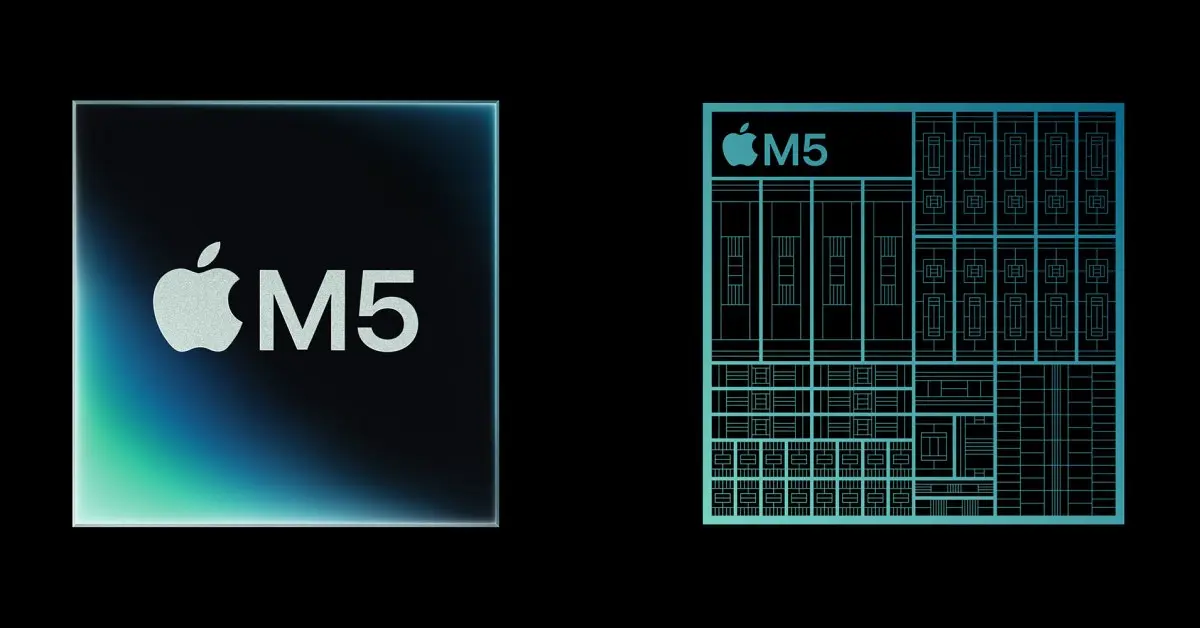

Apple-ის ახალი გეგმები: ჭკვიანი სათვალე, AI კულონი და კამერიანი AirPods

2026 წელს Nvidia არცერთ ახალ ვიდეობარათს არ გამოუშვებს

ინსაიდერები: Apple ქმნის ტანსაცმელზე დასამაგრებელ AI მოწყობილობას სამკერდე ნიშნის სახით

Sony-მ LinkBuds Clip Open წარადგინა — თავისი პირველი ყურსასმენები-კლიფსები

სოფტი

ყველას ნახვა

8 წლის შემდეგ, AsteroidOS 2.0 გამოვიდა – ახალი სიცოცხლე თქვენი სმარტ-საათისთვის

8 წლის შემდეგ, Linux-ზე დაფუძნებული ღია ოპერაციული სისტემა AsteroidOS დაბრუნდა განახლებული ვერსიით 2.0. ეს პროექტი მიზნად ისახავს ძველ სმარტ-საათებს ახალი სიცოცხლე შესძინოს და მომხმარებლებს Google-ისა და Apple-ის დახურული სისტემების ალტერნატივა შესთავაზოს. რა არის AsteroidOS? AsteroidOS არის სრულად ღია კოდის მქონე OS, რომელიც აგებულია Linux-ის ბაზაზე (OpenEmbedded). ის ორიენტირებულია კონფიდენციალურობაზე – არანაირი ტელემეტრია და იძულებითი ღრუბლოვანი […]

მიტჩელ ჰაშიმოტომ Vouch წარადგინა — ახალი ინსტრუმენტი Open Source სამყაროში “AI ნაგვის” წინააღმდეგ

League of Legends-ის სრული განახლება 2027 წელს გამოვა

Half-Life 3: ჭორები Steam Machine-თან ერთად 2026 წლის გაზაფხულზე გამოშვების შესახებ

Android Show: XR, Gemini და პარტნიორობა — Google-ის ახალი სტრატეგიის სამი საყრდენი

მეცნიერება

ყველას ნახვაბიზნესი

ყველას ნახვა

ტექნოლოგიური სფეროს კრიზისი: მასშტაბური გათავისუფლებები გრძელდება

Futurism-ის ახალი ანგარიშის თანახმად, ტექნოლოგიურ სექტორში დასაქმებულები სერიოზული გამოწვევების წინაშე დგანან. მხოლოდ ოქტომბრის თვეში აშშ-ის ტექნოლოგიურმა ინდუსტრიამ რეკორდული რაოდენობის – 33,281 თანამშრომელი გაათავისუფლა. მთავარი დეტალები: 📉 სტატისტიკა: მიმდინარე წელს უკვე 141,159 სამუშაო ადგილი გაუქმდა (შარშანდელთან შედარებით 20,000-ით მეტი). 🤖 მიზეზები: კომპანიები მასობრივად ამცირებენ ხარჯებს და ნერგავენ ხელოვნურ ინტელექტს (AI), რასაც “ქამრების შემოჭერას” და დაქირავების შეჩერებას […]

Samsung-ის ხელმძღვანელები და თანამშრომლები დააკავეს ჩინეთში 10-ნმ DRAM ტექნოლოგიის გაჟონვის გამო

უკრაინელები პირველები მიიღებენ Starlink-ის “პირდაპირ მობილურზე” სატელიტურ სერვისს ევროპაში

Starlink, უფრთხილდი: Amazon უშვებს თავის პირველ ზესწრაფ სატელიტურ ქსელს