ბევრი თვლის, რომ Google Pixel-ის კამერა საუკეთესოა. აპარატულად ის მცირედით თუ განსხვავდება კონკურენტებისგან – მთავარი პროგრამული უზრუნველყოფაა. გამოსახულების დამუშავება და ხელოვნური ინტელექტი სხვებსაც აქვთ თუმცა ბიუჯეტური პიქსელიც კი ჯობნის სხვა ფლაგმანებს ფოტოგრაფიაში. მოდით გავარკვიოთ თუ რით არის Google Pixel-ის ფოტოების დამუშავება უნიკალური და როგორ გახდა საძიებო გიგანტი მობილური ფოტოგრაფიის მეფე.

თანამედროვე მობილურ კამერებში ალგორითმები უფრო მნიშვნელოვანია ვიდრე კამერის მოდული, მაგრამ როცა იწყებ შესწავლას თუ როგორ მუშაობს Google-ის კამერა ხვდები, რომ ის გენიოსების შექმნილია.

HDR+

ყველას ახსოვს ალბათ, რომ პირველი სმარტფონი HDR+ ტექნოლოგიით Nexus 5 იყო, მაგრამ ალგორითმი არათუ მისთვის არამედ სმარტფონებისთვისაც კი არ იყო განკუთვნილი თავდაპირველად. მაშინ პრიორიტეტი ფუტურისტული და უკვე მივიწყებული Google Glass იყო.

ყველაფერი 2011 წელს დაიწყო, როცა ექსპერიმენტული ქვედანაყოფის Google X-ის მეთაურმა სებასტიან ტურნმა ყურადღება გაამახვილა ყურადღება იმაზე, რომ დიდ ოპტიკასა და მატრიცას სათვალეებში ვერ მოათავსებდა. კამერის ჩაყენება გარდაუვალი იყო და ამიტომაც გადაწყდა, რომ გამოსახულების გაუმჯობესება პროგრამულად უნდა მოეხდინათ. ამ ამოცანის გადასაწყვეტად მან სტენფორდის უნივერსიტეტის პროფესორი, გამოთვლით ფოტოგრაფიის ექსპერტი მარკ ლევოი მოიწვია.

მან სწორედ 2011 წელს გამოუშვე SynthCam, რომელიც iPhone 4-ზე აკეთებდა ფოკუსის გაბლარვის ეფექტს, რომელიც ახლა ძალიან პოპულარუალია. რა თქმა უნდა ეს მას არც ისე გამოსდიოდა, მაგრამ ის გახდა გუნდის მეთაური, რომელმაც სახელად Gcam დაირქვა.

ალგორითმის შექმნის წინაპირობად შემდეგი პრინციპები დაედო:

- მომენტალურობა

ფოტოს დამუშავებისთვის არ უნდა დაიხარჯოს რამდენიმე წამზე მეტი და ყველანაირი გამოთვლა უნდა მოხდეს ლოკალურად, მოწყობილობაზე. ამიტომაც ალგორითმი უნდა იყოს მარტივი გამოსათვლელი სმარტფონის პროცესორისთვის. - სრულად ავტომატიზებული

არანაირი პარამეტრები და მომხმარებლის მხრიდან ჩარევა და ალგორითმის დეტალებში გარკვევის საჭიროება. - ბუნებრივობა

ეფექტმა არ უნდა გახადოს მიღებული გამოსახულება სიურეალისტური, მულტიპლიკაციური. ღამის ფოტო არ უნდა გავდეს ცუდ დღის ფოტოს. ეს პრინიცპი დღემდე შენარჩუნებულია და HDR ფოტოგრაფიაში Google-ს ყველაზე მოზომილად აქვს გამოყენებული ალგორითმები სხვებისგან განსხვავებით. - კონსერვატიულობა

HDR+ უნდა განიხილებოდეს, როგორც გადაღების მთავარი რეჟიმი, არ უნდა ქონდეს არტეფაქტები, ხოლო შედეგი ყოველთვის უნდა აღემატებოდეს ჩვეულებრივ ფოტოს.

სწორედ ამ პრინციპებმა განაპირობა Gcam-ის გუნდის არასტანდარტული მიდგომა, რადგანაც ყველა დანარჩენი გადაწყვეტილება იმ დროისთვის ამ პირობებს არ აკმაყოფილებდა.

ზოგადად მობილურ ფოტოგრაფიაში დინამიური დიაპაზონის გაფართოება ბრეკეტინგის ტექნიკით მიიღწევა. უნდა გადავიღოთ რამდენიმე სურათი: ერთი ნორმალური განათებით, ერთი გადანათებული და ერთი ბნელი. შემდგომში ეს ფოტოები ერთიანდება: ჩრდილები გამოიყენება გადანათებული კადრიდან, შუქი ბნელი კადრიდან და სხვა დანარჩენი ჩვეულებრივი კადრიდან. ამის ხარჯზე ჩვენ მივიღებთ HDR გამოსახულებას, რაც დღეს ნებისმიერ სამარტფონს შეუძლია.

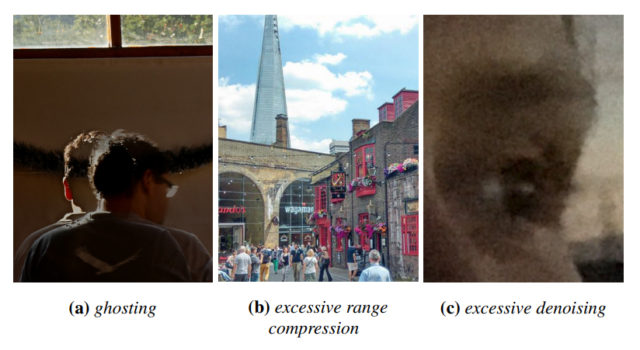

ასეთ მეთოდს ბევრი ნაკლი აქვს. პირველ რიგში სურათები სხვა და სხვა განათებით და შეყოვნებით რთულია გაერთიანდეს და არ დატოვოს არტეფაქტები, როგორიცაა გოუსთინგი. მეორე ამით საერთოდ არ გვარდება ხამურის პრობლემა, ამიტომაც აგრესიული ხმაურის ფილტრაციით ფოტოზე დეტალები იკარგება. ასევე ამ მეთოდის გამოყენებისას ხშირად ზედმეტი კომპრესია გამოიყენება და მიიღება არაბუნებრივი მულტიპლიკაციური გამოსახულება. ყველა ეს პრობლემა ამა თუ იმ დოზით დღემდე გვხვდება სმარტფონებში.

რა მოიფიქრეს Gcam-ის ინჟინრებმა? მათ გადაწყვიტეს, რომ უფრო ეფექტური იქნებოდა გაეერთიანებინათ არა სხვა და სხვა ექსპოზიციის კადრები, არამედ ერთნაირი ექსპოზიციით გადაღებული, უფრო ზუსტად ცოტათი ნაკლები ექსპოზიციით, განათების ნაკლებობით. ალოგიკურად ჟღერს? რაში შეიძლება გამოგვადგეს ბნელი ფოტოები? საიდან ავიღოთ ინფორმაცია ჩრდილების შესახებ? როგორ გადაწყვეტს ეს ხმაურის პრობლემას? სწორედ აქ იწყება Google-ის მაგია.

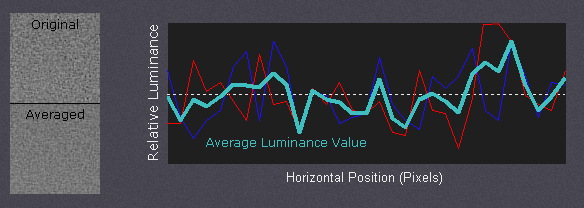

დავიწყოთ იმით, რომ ამ შემთხვევაში კადრები არ ერთიანდება, არამედ ერთმანეთს ედება ფენებად და ყოველ დადებაზე ფერების შესახებ ინფორმაცია საშუალოვდება. მოკლე ექსპოზიციით გადაღებული ფოტოები უფრო მკაფიო გამოდის და მათი ერთმანეთზე დადებისას ობიექტები ნაკლებად იდღაბნება.

ერთნაირი განათების მქონე სურათების ერთმანეთზე დადება მარტფივია და მცირე შეყოვნებით გადაღებისას უფრო მეტი სურათის გადაღება შეიძლება დროის მცირე მონაკვეთში. ყოველი პიქსელის შესახება ყოველი ფოტოდან ამოღებული ინფორმაციის გასაშაუალოებული მნიშვნელობებით საგრძნობლად მცირდება ხმაური და ნარჩუნდება ობიექტების დეტალიზაცია.

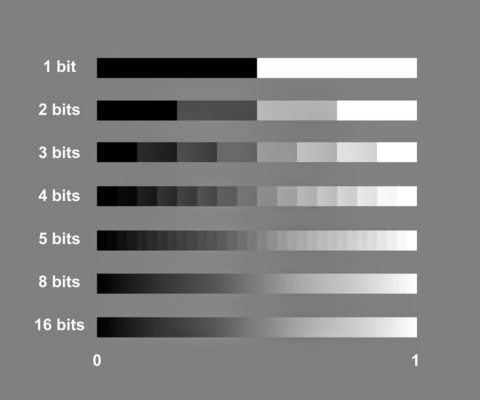

გარდა ფერების სიღრმე 10-დან 14 ბიტამდე იზრდება, რაც საშუალებას გვაძლევს ხელოვნურად ამოვქაჩოთ ჩრდილები ხილული არტეფაქტების გარეშე. ყველაფერი გენიალურად და მარტივად ჟღერს, მაგრამ სინამდვილეში ალგორითმი ძალიან რთულია, რადგან მან უნდა იმუშაოს ყველანაირ პირობებში, აკანკალებლ ხელებში, არ დასვას აკუმლატორი და არ შექმნას არტეფაქტები.

როგორ მუშაობს ალგორითმი

როცა თქვენ კამერის აპლიკაციას გაუშვებთ, ის უწყვეტი გადაღების რეჟიმში გადადის და ციკლურ ბუფერში 15-დან 30 კადრამდე იღებს, რაც განათების ინტენსივობაზეა დამოკიდებული. მაშინ, როცა თქვენ დააჭერთ ღილაკს ჩაწერა შეწყდება და დასამუშავებლად ბოლო კადრები გადაეცემა ალგორითმს ბუფერიდან. პირველი სამი კადრიდან შეირჩევა ყველაზე მკვეთრი, ხოლო შემდგომში მასზე დაედება ყველა დანარჩენი კადრი, მათ გარდა, რომლებიც უცვლელი დარჩა. ყველი კადრი შედარდება სხვა დანარჩენს და ყველა შეცვლილი რეგიონი გამოიცხრილება. შეერთებული კადრის მიღების შემდეგ საქმეში სხვა ალგორითმები ჩაერთვება, რომლებიც მოაშორებენ ხმაურს, აბერაციას, ბოლს, ვინეტს, გაიზრდება კონტრასტი, სიმკვეთრე და ა. შ. ამ მომენტში ხდება თეთრის ავტომატური ბალანზი, დებაერიზაცია, ტონალური კომპრესია, ქრომატული აბერაციების მოშორება, ნახევარტონების შერბილება, გამა კორექცია და ეს ყველაფერი ავტომატურად!

გამოცდილი ფოტოგრაფებისთვის და უბრალოდ მოყვარულებისთვის Pixel 3-ში შესაძლებელია RAW ფაილების შენახვა, რომელიც რამდენიმე კადრის გაერთიანებისას მიიღება. ამ შემთხვევაში თქვენ ერთდროულად იღებთ გამოთვლით ფოტოგრაფიის ყველა პლიუსს და სრულ შემოქმედებით თავისუფლებას.

რა თქმა უნდა Google ერთადერთი არ არის ვისაც გამოთვილითი ფოტოგრაფია გამოსდის. iPhone XS-ში Apple-მა თავისი მაგიური ალგორითმი წარმოადგინა. ფილ შილერი ამბობს, რომ ტექნოლოგია ციკლურ ბუფერში 4 კადრს ატრიალებას ნორმალური ექსპოზიციით და 4 შუალედურ კადრს ნორმალურით, ასევე იღება ერთი ნათელი კადრი უფრო ხანგრძლივი ექსპოზიციით. შემფგომში ნეირონული ქსელი ანალიზს უკეთებს ყველა ზემოთ ჩამოთვლილ კადრს და წარმატებულ ფრაგმენტებს ერთიანებს.

მუშაობის პრინციპი Google-ის რეალიზაციის მსგავსია, მაგრამ სამი სხვა და სხვა ექსპოზიციის მქონე კადრის გამოყენების გამო, მსგავსი ალგორითმი ძალიან რთული განსახორციელებელია ისე, რომ არ მივიღოთ გოუსთინგი და ფერების მაღალი კომპრექსია. გარდა ამის აასეთი მეთოდი თეორიულად უფრო რთული და მძიმე უნდა იყოს პროცესორისთვის. მიუხედავად ყველაფრისა Apple-ის გუნდმა ამ ამოცანას თავი შესანიშნავად გაართვა და iPhone ყველაფერს რეალურ დროში ითვლის, ანუ ეკრანზე თქვენ უკვე ხედავთ გადაღებულ ფოტოს, რაც Google-ის შემთხვევაში მოხლოდ გადაღების შემდეგ გალერეაშია შესაძლებელი.

Gcam-ის გუნდის ალგორითმის უპირატესობები:

- საგრძნობლად მცირდება ხმაური, პრაქტიკულად არ იკარდება დეტალიზაცია

- თითქმის უარტეფაქტო სურათი

- ბუნებრივი ფერები

- მკაფიო გამოსახულება, თუნდაც სწრაფად მოძრავი ობიექტის გადაღებისას

რა თქმა უნდა ამ მიდგომასაც აქვს მინუსები. პირველ რიგში ის, რომ გადაღებისას ცნობლი არ არის როგორი გამოვა ფინალური შედეგი, იმიტომ, რომ ეკრანზე პირადპირ მატრიციად მიღებული გამოსახულება ჩანს ალგორითმების გამოყენების გარეშე. მეორე ის, რომ ფოტოს დასანახად უნდა დაველოდოთ გამოსახულების დამუშავებას, რაც ხანდახან გამაღიზიანებელია, მაგრამ საბოლოო შედეგი ნამდვილად ღირს ამად.

მათ ვისაც გაინტერესებთ თუ როგორ მუშაობს ალგორითმი უფრო დეტალურად, მათემატიკური ფორმულებით და სრული სამეცნიერო ანალიზით შეგიძლიათ გაეცნოთ მასალებს, რომლებიც სტენფორდის უნივერსიტეტის საიტზეა გამოქვეყნებული.